LLM(大規模言語モデル)との対話で、

「以前の話を覚えていてくれたら…」と感じたことはありませんか。何度も同じ説明を繰り返したり、文脈を無視した回答にがっかりしたりするのは、LLMが対話の履歴をすぐに忘れてしまう「健忘症」のような性質を持つためです。この課題を解決する鍵が「長期記憶」技術です。

この記事では、LLMに長期記憶を持たせる仕組みから、2026年時点の最新技術、具体的なビジネス活用事例、そして実装のポイントまでを網羅的に解説します。最後まで読めば、自社のサービスや業務に「忘れないAI」を導入するための具体的な道筋が見えるはずです。AI導入の具体的な進め方や効果をまとめた資料もご用意していますので、ぜひご活用ください。

なぜLLMに長期記憶が必要なのか?「健忘症AI」問題の克服

結論として、LLMに長期記憶が不可欠なのは、標準状態のモデルが対話の文脈(コンテキストウィンドウ)を超える情報を記憶できないという、根本的な制約を抱えているためです。この課題は「健忘症AI」問題とも呼ばれ、ユーザー体験を大きく損なう一因となっています。一度の対話で扱える情報量には上限があり、その上限を超えると過去のやり取りは忘れ去られてしまうのです。

例えば、AIチャットボットに会社の基本情報を伝えた後、別の話題を挟んでから「先ほど伝えた情報に基づいて資料を作成して」と指示しても、AIは「そのような情報は伺っていません」と答えることがあります。これは、対話の履歴がコンテキストウィンドウから溢れてしまった結果に他なりません。この制約があるために、ユーザーは同じ情報を何度も入力せねばならず、パーソナライズされた体験を得るのが難しくなっていました。

長期記憶技術は、この問題を根本から解決します。対話の重要な情報をLLMの外部にある専用のデータベースに保存し、必要な時にいつでも取り出せるようにすることで、対話の継続性と一貫性を担保します。これにより、ユーザー一人ひとりに合わせた、より人間らしいコミュニケーションが実現可能になるのです。

https://media.a-x.inc/ai-limitations

https://media.a-x.inc/ai-chatbot

LLMの長期記憶とは?基本的な仕組みを解説

LLMの長期記憶とは、対話の履歴や外部の知識源といった情報を、LLM本体とは別の永続的なストレージ(記憶装置)に保存し、必要に応じて参照させる仕組みを指します。これにより、LLMはコンテキストウィンドウの制約を超えて、過去の情報を「思い出す」ことが可能になります。この仕組みの中核を担うのが、短期記憶と長期記憶の役割分担、そして情報を効率的に探し出すための技術です。

短期記憶(コンテキスト)と長期記憶の違い

LLMにおける記憶は、人間の記憶モデルと同様に「短期記憶」と「長期記憶」に大別できます。短期記憶はLLMのコンテキストウィンドウそのものであり、高速にアクセスできる反面、容量に限りがあり、対話が終了すると消えてしまう揮発性のメモリです。最新の高性能モデルにおいても、このコンテキストウィンドウのサイズが性能の一つの指標となります。

一方で、長期記憶は外部のデータベースに情報を永続的に保存します。アクセス速度は短期記憶に劣りますが、容量の制限が事実上なく、情報を半永久的に保持できるのが最大の特長です。この2種類の記憶を連携させることで、AIは直近の文脈を素早く理解しつつ、過去の重要な情報も踏まえた深い応答を生成できるようになります。(出典:生成系 AI アプリケーションのデータベースを選択する際の主な考慮事項)

| 項目 | 短期記憶(コンテキスト) | 長期記憶(外部データベース) |

|---|---|---|

| 役割 | 現在の対話の文脈保持 | 過去の対話や知識の永続的な保存 |

| データ保持期間 | 一時的(対話終了時に消滅) | 永続的 |

| 容量 | 限定的(モデル依存) | ほぼ無制限 |

| アクセス速度 | 非常に高速 | 比較的低速 |

| 主な技術 | Transformerアーキテクチャ | ベクトルデータベース、知識グラフ |

ベクトルデータベースと知識グラフの役割

長期記憶を実現する上で中心的な役割を果たすのが、「ベクトルデータベース」と「知識グラフ」です。ベクトルデータベースは、テキストや画像などの情報を「ベクトル」と呼ばれる数値の配列に変換して保存します。このベクトルの近さによって意味の近さを表現できるため、「あの時話した、新製品の件」といった曖昧な検索でも、関連性の高い情報を高速に見つけ出すことが可能です。これはRAG(Retrieval-Augmented Generation)と呼ばれる技術の根幹をなしています。(出典:生成系 AI アプリケーションのデータベースを選択する際の主な考慮事項)

もう一方の知識グラフは、情報(ノード)と情報同士の関係性(エッジ)をグラフ構造で表現する技術です。「A社のCEOはB氏」で、「A社はC社の子会社」といった複雑な関係性を正確に記憶し、人間のような推論をサポートします。これら2つの技術を組み合わせることで、LLMは膨大な情報の中から必要なものを的確に取り出し、長期的な記憶として活用できるのです。

https://media.a-x.inc/ai-rag

https://media.a-x.inc/aI-vectorization

https://media.a-x.inc/llm-memory

長期記憶を構成する主要なメモリタイプ

LLMの長期記憶は、単一の記憶領域ではなく、人間の記憶システムを参考に、複数の異なるタイプのメモリで構成されます。これにより、多様な情報を整理し、状況に応じて適切に活用することが可能になります。主要なメモリタイプは4つに分類され、それぞれがAIの応答の質とパーソナライゼーションを向上させるために重要な役割を担っています。

これらのメモリタイプを適切に組み合わせることで、AIは単なる情報検索ツールを超え、ユーザーとの関係性を築きながら成長するパートナーへと進化します。以下に、それぞれのメモリタイプの役割を解説します。

- エピソード記憶:ユーザーとAIの過去の対話履歴そのものを時系列で保存します。「いつ、誰が、何をしたか」という具体的な出来事を記憶するもので、カスタマーサポートなどで過去の問い合わせ履歴を参照する際に不可欠です。

- 意味記憶:一般的な事実や知識を体系的に保存します。例えば、製品のマニュアルや業界の専門知識などがこれにあたり、AIが正確で信頼性の高い情報を提供する基盤となります。

- 手続き記憶:「特定のタスクを実行するための手順」を記憶します。社内システムの操作方法や報告書の作成手順などを覚えさせることで、AIは業務を代行するエージェントとして機能できます。

- 選好記憶:ユーザーの好みや設定、目標などを記録するメモリです。これにより、一人ひとりのユーザーに合わせた高度なパーソナライゼーションが実現します。

これらの記憶を統合的に管理することで、AIはより人間らしく、文脈に応じた柔軟な対応が可能になるのです。

【2026年最新】LLMの長期記憶を実現する主要技術・ツール3選

2025年現在、LLMの長期記憶を実装するための様々な技術やツールが登場しており、特にオープンソースコミュニティを中心に開発が活発化しています。これらのツールは、開発者がより簡単に、かつ高度なメモリ機能を自身のアプリケーションに組み込むことを可能にします。ここでは、異なる特徴を持つ代表的な3つの選択肢を紹介します。選定基準は、オープンソースでの注目度、既存エコシステムとの連携性、そしてエンタープライズ対応力です。(出典:【論文解説】生成AIに「記憶」を持たせる技術の全体像)

これらのツールはそれぞれ異なる特長を持ち、プロジェクトの要件や既存の技術スタックに応じて選択することが重要です。自己改善機能を持つものから、既存のエコシステムとの連携を重視したもの、エンタープライズ向けの堅牢なソリューションまで、選択肢は多岐にわたります。

1. Mem0:自己改善するオープンソースメモリ

Mem0は、自己改善機能を備えたインテリジェントなメモリミドルウェアです。最大の特徴は、保存された情報をAI自身が分析し、重複する内容を統合したり、重要でない情報を要約・圧縮したりする点にあります。これにより、メモリの肥大化を防ぎ、常に最適化された状態で情報を保持できます。開発者は、冗長なデータを管理する手間から解放され、より効率的に長期記憶システムを構築・運用できます。(出典:Introducing Mem0: The Self-Improving Memory Layer for AI)

2. LangMem:LangChainエコシステムとの強力な連携

LangMemは、LLMアプリケーション開発のフレームワーク「LangChain」向けに開発されたメモリ管理ライブラリ(SDK)です。LangChainを利用している開発者であれば、わずか数行のコードでアプリケーションに長期記憶機能を追加できます。会話履歴の保存や要約、ベクトルストアとの連携など、メモリ管理に必要な基本機能が網羅されており、LangChainのエコシステム内でシームレスに開発を進められる点が大きなメリットです。(出典:LangChain Announces LangMem SDK for Building Stateful LLM Applications)

3. Zep:エンタープライズ向けの長期メモリクラウド

Zepは、特にエンタープライズ用途を想定して設計された長期記憶プラットフォームです。オンプレミスでの自己ホスト、またはクラウドサービスとして利用できます。ユーザーごとの対話履歴を自動的にベクトル化・要約し、高速なセマンティック検索を可能にします。また、ユーザー管理機能やセキュリティ面も強化されており、大規模な商用サービスに求められるスケーラビリティと信頼性を提供します。(出典:Zep – Long-term Memory for AI)

https://media.a-x.inc/ai-new

https://media.a-x.inc/llm-open-source

LLMの長期記憶がもたらすビジネス上のメリット

LLMに長期記憶を実装することは、単なる技術的な進歩にとどまらず、ビジネスに具体的かつ大きなメリットをもたらします。最大の利点は、顧客体験(CX)の劇的な向上と、社内業務プロセスの抜本的な効率化です。AIがユーザーや業務に関する情報を忘れなくなることで、これまで不可能だったレベルのパーソナライゼーションと自動化が実現します。(出典:顧客体験(CX)向上のための生成AI活用とは? 3つのポイントと国内外の事例を解説)

これにより、企業は顧客満足度の向上による売上増加と、業務効率化によるコスト削減という、事業成長の両輪を同時に加速させることが可能になります。以下に、長期記憶がもたらす主要なビジネスメリットを挙げます。

- 顧客体験のパーソナライズ:過去の購買履歴や好みを記憶し、一人ひとりに最適化された提案を実現。

- 問い合わせ対応の高速化・高度化:過去の対話履歴を踏まえ、迅速かつ一貫性のあるサポートを提供。

- 社内ナレッジの有効活用:過去の議事録や資料をAIが記憶し、必要な情報を即座に検索・提示。

- 従業員の業務負荷軽減:定型的な情報提供や繰り返し作業をAIが代行し、生産性を向上。

顧客体験のパーソナライズは、Eコマースサイトでのレコメンデーション精度向上や、個人の投資スタイルに合わせた金融アドバイスの提供といった形で現れます。問い合わせ対応においては、過去のやり取りを全て把握したAIが対応することで、顧客は同じ説明を繰り返す必要がなくなり、初回解決率(FCR)の改善が期待できます。

社内では、過去のプロジェクト資料や議事録を記憶したAIが、必要な情報を即座に提示してくれるため、ナレッジ検索の時間が大幅に短縮されます。これにより、従業員はより付加価値の高い創造的な業務に集中できるようになり、組織全体の生産性向上に直結します。

https://media.a-x.inc/ai-benefits

https://media.a-x.inc/ai-business

【業界別】LLM長期記憶の具体的な活用事例

LLMの長期記憶技術は、既に様々な業界で具体的なアプリケーションとして活用され始めています。顧客との長期的な関係構築が重要な業界や、膨大な知識の管理が求められる分野で特にその効果を発揮しており、革新的なサービスが次々と生まれています。ここでは、代表的な3つの業界における活用事例を紹介します。

これらの事例は、長期記憶が単なる対話の記録に留まらず、ビジネスの根幹を支える強力なツールとなり得ることを示しています。

カスタマーサポート:過去の問い合わせ履歴を踏まえた一貫した対応

カスタマーサポートセンターでは、AIチャットボットが顧客一人ひとりの過去の問い合わせ履歴、購入製品、解決状況などをすべて記憶します。これにより、顧客がどのタイミングで、どのチャネル(電話、チャット、メール)から連絡しても、常に文脈を理解した一貫性のあるサポートを提供できます。担当者が変わるたびに同じ説明を繰り返す必要がなくなり、顧客満足度の向上とオペレーターの負担軽減を同時に実現します。

Eコマース:個人の嗜好や閲覧履歴に基づく高度なレコメンデーション

Eコマースサイトでは、ユーザーの同意に基づき、AIが過去の閲覧履歴や購入商品などの情報を記憶します。この記憶に基づき、単に人気商品を推薦するのではなく、「先月ご覧になったジャケットに合うパンツはこちらです」といった、個人の潜在的なニーズを先読みした提案を行います。もちろん、これらの個人データは、利用目的の明示やユーザーによる削除権の確保といったプライバシー保護の原則に則って厳格に管理される必要があります。これにより、コンバージョン率の向上と顧客ロイヤルティの強化が期待できます。

教育・トレーニング:学習者ごとの進捗と理解度に応じた個別指導AI

オンライン教育プラットフォームでは、AIチューターが学習者一人ひとりの解答履歴、正答率、学習時間、苦手分野を長期的に記憶します。AIはこれらの記憶を分析し、学習者がつまずいているポイントを特定して追加の解説を行ったり、理解度に応じた最適な練習問題を出題したりします。完全なアダプティブラーニング(適応学習)が実現し、学習効率を最大化させることが可能です。

国内企業の事例:AX CAMP導入による業務効率化

国内のマーケティング支援企業であるRoute66様では、AX CAMPの研修を通じてAI活用を内製化しました。AIに過去のデータや文脈を記憶させ、特定の条件下でコンテンツ生成を支援させることで、従来24時間かかっていた原稿執筆がわずか10秒に短縮されるという成果を上げています。(出典:原稿執筆が24時間→10秒に!Route66社が実現したマーケ現場の生成AI内製化)

また、SNS広告を手掛ける株式会社WISDOM様では、AIが候補者とのやり取りやスケジュールを記憶し、面接調整などの一部業務を自動化しました。これにより、採用担当2名分の工数に相当する日程調整業務(毎日2時間)を効率化し、コア業務への集中を可能にしています。(出典:採用予定2名分の業務をAIが代替!WISDOM社、毎日2時間の調整業務を自動化)

※上記の事例は特定の条件下での成果であり、すべてのケースで同様の効果を保証するものではありません。

https://media.a-x.inc/ai-use-case

https://media.a-x.inc/llm-use-cases

自社に最適な長期記憶ツールの比較・選定ポイント

LLMの長期記憶ツールを導入する際には、自社の目的や技術環境に最適なものを選ぶことが成功の鍵となります。多種多様なツールが存在するため、「目的」「技術スタック」「セキュリティ」の3つの観点から比較検討することが重要です。これらのポイントを事前に整理することで、導入後のミスマッチを防ぎ、投資対効果を最大化できます。

やみくもに最新のツールを導入するのではなく、自社の課題解決に直結するかどうかを冷静に見極める視点が求められます。以下に、具体的な選定ポイントを5つ挙げます。

- オープンソースかクラウドか:柔軟なカスタマイズ性を重視するならオープンソース、迅速な導入とインフラ管理の簡素化を求めるならクラウドサービスが適しています。

- 対応するベクトルデータベース:既存のデータベース環境や好みのベクトルデータベース(例: Pinecone, Weaviate, Qdrantなど)に対応しているかを確認します。

- 開発エコシステムとの連携性:LangChainやLlamaIndexといった主要な開発フレームワークとの連携が容易かどうかも、開発効率を大きく左右します。

- セキュリティとコンプライアンス:個人情報や機密情報を扱う場合、データの保存場所、暗号化、アクセス制御といったセキュリティ要件を満たしているかが最優先事項です。(出典:特定個人情報の適正な取扱いに関するガイドライン(事業者編))

- 導入・運用コスト:ライセンス費用やクラウド利用料、そして学習コストを含めた総所有コスト(TCO)を算出し、予算内で最大の効果が見込めるツールを選定しましょう。

これらの要素を総合的に評価し、自社の状況に最もフィットするツールを選ぶことが、プロジェクト成功への第一歩となります。

長期記憶を実装する際のアーキテクチャ設計パターン

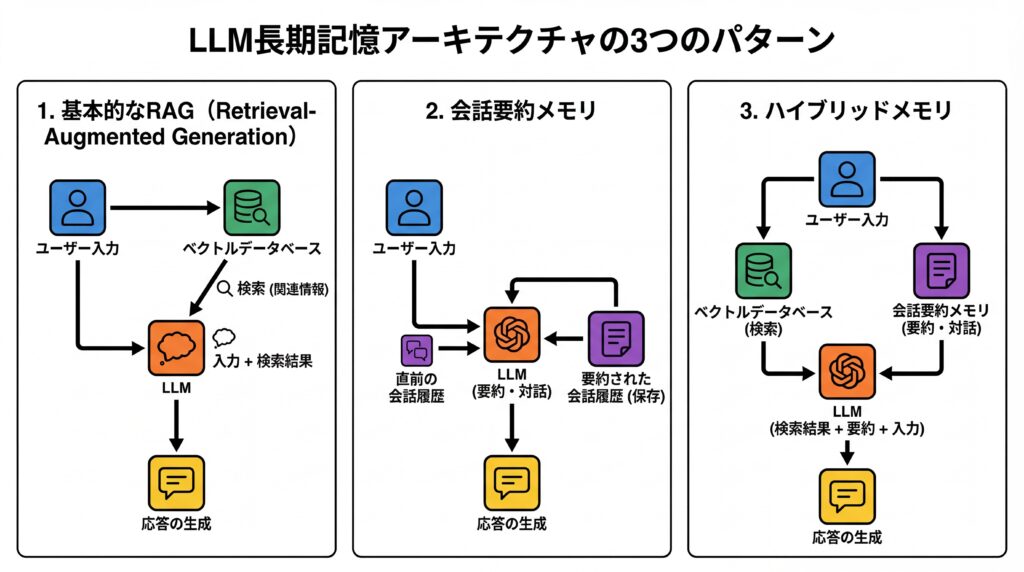

LLMの長期記憶をシステムに実装する際のアーキテクチャは、その中核にRAG(Retrieval-Augmented Generation)を据えるのが一般的です。しかし、メモリをいつ、どのように更新・参照するかによって、いくつかの設計パターンが存在します。システムの要件に応じて最適なパターンを選択することが、性能と効率を両立させる上で不可欠です。

ここでは、基本的かつ代表的なアーキテクチャ設計パターンを3つ紹介します。これらをベースに、自社のユースケースに合わせてカスタマイズしていくことになります。

- 基本的なRAGパターン:最もシンプルな実装です。ユーザーからの入力があるたびに、その入力と意味的に類似する情報をベクトルデータベースから検索し、プロンプトに埋め込んでLLMに渡します。実装が容易で、多くのユースケースで有効です。

- 会話要約メモリパターン:長い対話を扱う際に有効です。対話が一定の長さに達するたびに、それまでの会話内容をLLMに要約させ、その要約をメモリに保存します。これにより、コンテキストウィンドウを圧迫することなく、過去の文脈全体を維持できます。

- ハイブリッドメモリパターン:最も高度なアプローチです。ベクトルデータベース(エピソード記憶)と知識グラフ(意味記憶)を併用します。ユーザーとの対話履歴と、事前に構築した専門知識データベースの両方を参照することで、より正確で深い洞察に基づいた応答を生成できます。

効果的な記憶管理と運用のためのベストプラクティス

長期記憶システムは、一度構築すれば終わりではありません。その価値を維持し、向上させ続けるためには、記憶の質を継続的に管理・運用するための仕組みが不可欠です。放置されたメモリは、情報が陳腐化したり、不正確な情報が蓄積されたりすることで、かえってAIの性能を低下させる原因にもなりかねません。

効果的な記憶管理は、人間が学習と忘却を繰り返して知識を整理するプロセスに似ています。AIにも同様に、記憶を取捨選択し、最新の状態に保つためのベストプラクティスを適用することが重要です。

- 記憶のスコアリングと優先順位付け:すべての情報を同等に扱うのではなく、アクセスの頻度や重要度に応じて記憶にスコアを付け、優先順位を決定します。

- 定期的な記憶の棚卸しと更新:製品情報や社内規定など、時間とともに変化する情報については、定期的に内容を見直し、最新の状態に更新するプロセスを確立します。

- ユーザーによる記憶の編集・削除機能:ユーザーがAIに記憶された自身の情報を確認し、必要に応じて編集や削除を要求できる機能を提供することは、プライバシー保護の観点からも極めて重要です。

- フィードバックループの構築:AIの応答が記憶を正しく活用できていたかをユーザーが評価できるフィードバックループを設けることで、AIは自身の記憶の精度を継続的に改善できます。

これらの運用プラクティスを導入することで、長期記憶システムは常に信頼性が高く、ビジネス価値を生み出し続ける資産となります。

長期記憶技術が抱える課題と今後の展望

LLMの長期記憶技術はビジネスに大きな可能性をもたらす一方で、克服すべき重要な課題も抱えています。特に、プライバシー保護と、AIが意図せず誤った学習を進めてしまうリスクは、技術導入を進める上で必ず考慮しなければならない点です。これらの課題への対処が、今後の技術普及の鍵を握っています。

これらの課題を乗り越えた先には、より高度で自律的なAIの実現という明るい未来が待っています。技術の進化と倫理的な枠組みの整備が両輪となって、今後の発展が進んでいくでしょう。

プライバシーとデータセキュリティの確保

長期記憶は、その性質上、ユーザーの個人情報や企業の機密情報など、センシティブな情報を大量に、かつ永続的に保存する可能性があります。この「記憶する」という行為自体が、情報漏洩や不正利用のリスクを増大させることにつながります。ひとたびデータが外部に流出すれば、その被害は甚大なものになりかねません。

この課題に対応するためには、保存するデータの暗号化や厳格なアクセス制御ポリシーの適用が重要です。また、個人情報保護法やGDPR(EU一般データ保護規則)などの法規制を遵守したデータ管理体制の構築が求められます。(出典:特定個人情報の適正な取扱いに関するガイドライン(事業者編))実際のセキュリティ要件は業種や扱うデータによって異なるため、個別の法務・セキュリティ担当者と確認しながら進めることが不可欠です。

自己改善ループによる意図しない学習のリスク

Mem0のような自己改善機能を持つメモリは、AIが自律的に学習し賢くなっていく上で非常に強力です。しかし、この自己改善ループが、誤った情報や社会的なバイアスを学習し、増幅させてしまう危険性もはらんでいます。例えば、インターネット上の誤った情報を事実として記憶してしまったり、特定の偏見を強化するような応答を繰り返すようになったりする可能性があります。

このリスクを低減するためには、AIの学習プロセスを完全に自動化するのではなく、要所で人間が介在して判断を検証する「ヒューマン・イン・ザ・ループ(Human-in-the-Loop)」の仕組みを組み込むことが重要です。AIが何を学習し、どのように記憶を更新したのかを追跡できる透明性と監査可能性の確保が、今後の重要な研究開発テーマとなります。

LLMの長期記憶活用ならAX CAMPの専門サポートへ

LLMの長期記憶技術を自社ビジネスに活用したいと考えても、「どのツールを選べば良いかわからない」「具体的なアーキテクチャ設計が難しい」「セキュリティ面が不安」といった課題に直面することは少なくありません。技術が急速に進化しているからこそ、机上の知識だけでなく、実践的なノウハウに基づいた導入計画が成功の鍵を握ります。

私たちAX CAMPは、法人向けに特化した実践型のAI研修・伴走支援サービスを提供しています。貴社の具体的なビジネス課題や既存システムを深く理解した上で、最適な長期記憶技術の選定から、セキュアなアーキテクチャの設計、そして効果的な運用体制の構築までを一気通貫でサポートします。単にツールを提供するのではなく、貴社自身がAIを使いこなし、継続的に成果を出し続けるためのスキルと組織作りをお手伝いします。

本記事で解説したような最新技術を、どのように自社の業務効率化や顧客体験向上に結びつけられるか。その具体的なステップを、専門家と一緒に描いてみませんか。まずは無料相談にて、貴社が抱える課題やAI活用の展望をお聞かせください。無理な勧誘は一切行いませんので、情報収集の場としてお気軽にご活用いただけます。

まとめ:LLMの長期記憶技術で「忘れないAI」を実現する

本記事では、LLMの「健忘症」問題を解決する長期記憶技術について、その基本的な仕組みから最新ツール、ビジネス活用事例、そして実装上の課題までを網羅的に解説しました。LLMがユーザーとの対話や重要な知識を忘れなくなることで、ビジネスの可能性は大きく広がります。

この記事の要点を以下にまとめます。

- LLMの長期記憶は「健忘症」を克服し、対話の一貫性を実現する技術です。

- ベクトルデータベース等を活用し、LLM外部に情報を永続保存することで実現します。

- 顧客体験の向上と業務効率化に直結する大きなビジネスメリットがあります。

- 実装にはプライバシーやセキュリティへの十分な配慮が不可欠です。

長期記憶技術を使いこなすことは、これからのAI活用における競争優位性の源泉となります。パーソナライズされた顧客対応や、社内ナレッジを完全に記憶した業務アシスタントは、もはや未来の話ではありません。

AX CAMPでは、この記事で紹介したような高度なAI技術を、貴社が確実にビジネスの成果に結びつけられるよう、専門家が伴走支援します。技術選定から実装、運用まで、AIプロジェクトのあらゆる段階でサポートが可能です。「忘れないAI」を自社に導入し、競合他社に差をつける次の一歩を踏み出しませんか。まずは、無料の資料請求やオンライン相談で、その可能性をご確認ください。