「LLM(大規模言語モデル)が画像も認識できるようになったと聞くけれど、具体的に何がすごいのだろう?」

「従来の画像認識技術と何が違うのか、ビジネスにどう活かせるのか知りたい」。そんな疑問をお持ちではないでしょうか。

LLMによる画像認識は、単に画像に写っているモノを識別するだけでなく、その状況や文脈まで深く理解し、人間と対話するように情報を引き出せる革新的な技術です。この進化により、これまで自動化が難しかった多くの業務で、飛躍的な効率化や新たな価値創出が期待されています。

この記事では、LLMによる画像認識の基本的な仕組みから、従来のAIとの違い、具体的なビジネス活用事例、そして2026年最新の注目モデルまでを網羅的に解説します。最後まで読めば、LLMの画像認識技術の全体像を掴み、自社ビジネスへの応用を具体的に検討できるようになるでしょう。AIのビジネス活用に関するヒントをまとめた資料もご用意していますので、ぜひご活用ください。

LLMによる画像認識とは?

LLMによる画像認識とは、テキスト情報だけでなく、画像に含まれる情報も深く理解し、それらを統合して処理するAI技術を指します。これにより、AIは画像の内容を説明したり、質問に答えたり、画像に基づいた新しいコンテンツを生成したりできます。この能力の根幹にあるのが「マルチモーダルLLM」という考え方です。

マルチモーダルLLMの基本概念

マルチモーダルLLMは、テキスト、画像、音声、動画といった複数の異なる種類(モダリティ)のデータを同時に扱える大規模言語モデルのことです。従来のLLMがテキスト情報のみを処理対象としていたのに対し、マルチモーダルLLMは複数の情報源から文脈を統合的に理解できる点が大きな特長と言えます。例えば、料理の写真を見せながら「このレシピを教えて」と質問すると、画像とテキストの両方を理解して適切なレシピを回答できるのです。

VLM(Vision-Language Model)との関係性

VLM(Vision-Language Model)は、特に「視覚(Vision)」と「言語(Language)」の2つのモダリティの扱いに特化したモデルを指します。これは、マルチモーダルLLMという大きな枠組みの中に含まれる、画像認識に特化した分野と位置づけられます。VLMの進化が、今日の高度なLLM画像認識技術の基盤を築いてきました。VLMはLLMの「目」の役割を担っていると考えると分かりやすいでしょう。

テキストと画像を同時に処理する能力

LLMの画像認識が持つ最も重要な能力は、テキストと画像を切り離さず、一連のデータとして同時に処理できる点にあります。ユーザーが画像と一緒に「この写真に写っている人物は何をしていますか?」といった自然な言葉で質問を投げかけると、LLMは画像内の視覚情報と言語情報を関連付け、「公園のベンチで本を読んでいる女性がいます」のように文脈を踏まえた回答を生成します。この統合的な処理能力こそが、多様なビジネス応用を可能にしているのです。

https://media.a-x.inc/llm-multimodal従来の画像認識AIとの違い

LLMによる画像認識は、特定のタスクに特化していた従来の画像認識AIとは一線を画します。結論として、その最大の違いは、タスクの柔軟性、文脈を理解する能力、そして対話を通じた操作性の3点に集約されます。これにより、従来モデルでは対応できなかった、より複雑で曖昧な要求にも応えられるようになりました。

タスク特化型モデルとの柔軟性の違い

従来の画像認識AIは、「猫の品種を識別する」「特定の製品を検出する」といった、単一の目的のために設計された「タスク特化型」が主流でした。そのため、新しいタスクに対応させるには、その都度大量の学習データを用意し、モデルを再構築する必要があったのです。一方、LLMはプロンプト(指示文)を変更するだけで、画像の要約、質疑応答、簡単なオブジェクトの識別など、多種多様なタスクを柔軟に実行できます。ただし、高精度の物体検出や測定が求められる場面では、専用の検出モデルと組み合わせるハイブリッド構成が依然として実用的です。

文脈理解と対話能力の有無

従来のモデルは、画像から「犬」「車」といったオブジェクトを検出できても、それらがどのような状況にあるかという文脈までは理解できませんでした。LLMは画像全体の状況を把握し、「公園で少年が犬とフリスビーで遊んでいる」といった関係性やストーリーを読み取ることができます。さらに、「この犬の種類は何ですか?」といった追加の質問に対しても、対話形式で深掘りして回答する能力を持っています。

ゼロショット・フューショット学習能力

LLMの特筆すべき能力の一つに、ゼロショット学習やフューショット学習があります。ゼロショット学習とは、一度も学習したことのないタスクでも指示のみで実行できる能力を指します。フューショット学習は、ほんの数例のサンプル(ショット)を与えるだけで、新しいタスクに適応できる能力です。これにより、従来のように何千、何万もの学習データを用意することなく、迅速に新しい画像認識タスクへ対応させることが可能になりました。

LLMが画像認識できる仕組み

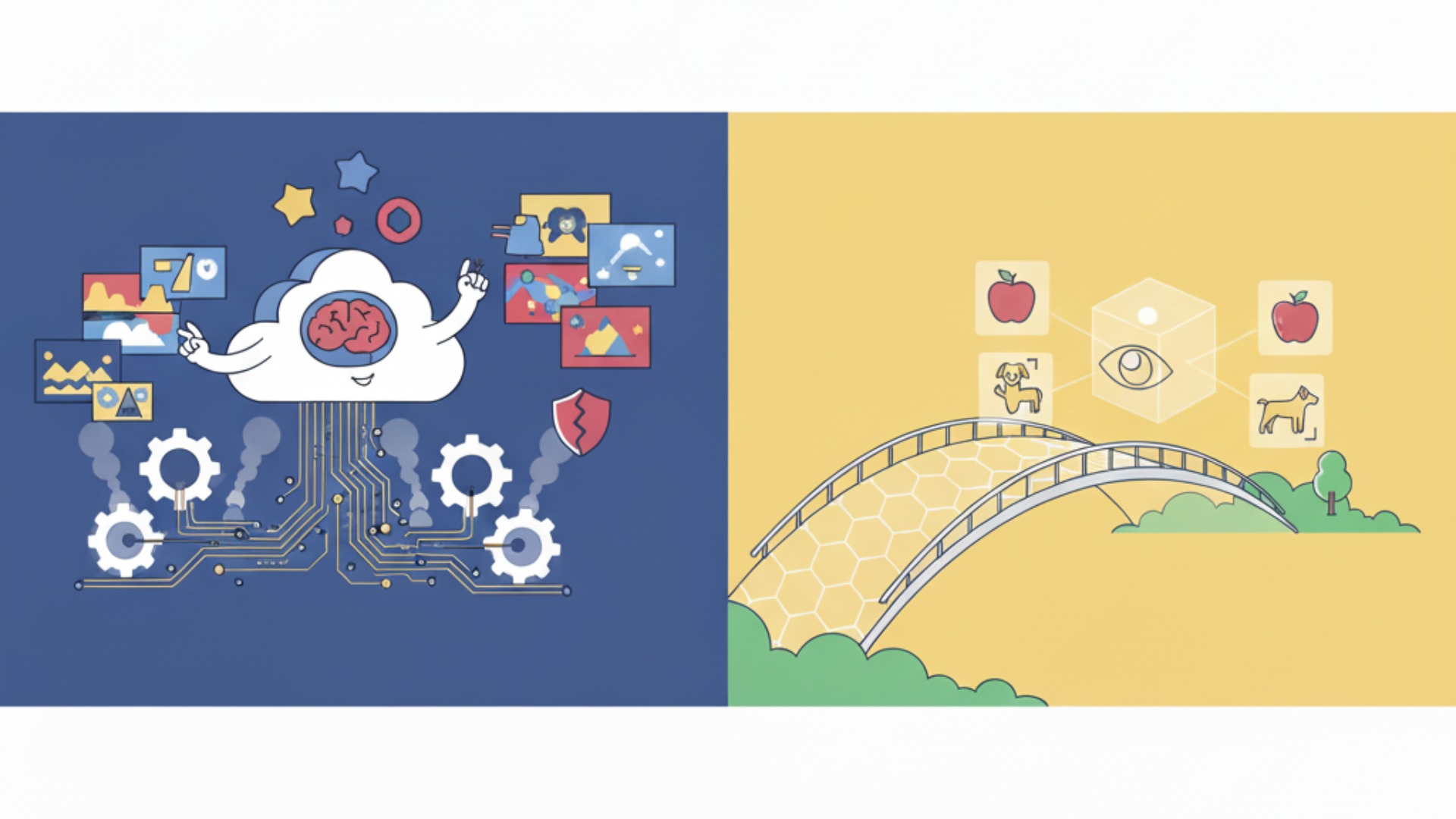

LLMは一体どのようにして画像の内容を「理解」しているのでしょうか。その核心は、ピクセル情報の羅列である画像を、LLMが解釈可能な数値データ(特徴ベクトル)に変換し、それをテキスト情報と統合するプロセスにあります。この変換と統合は、主に「画像エンコーダー」と、それをLLMに接続する「アダプターモジュール」という2つの要素によって実現されます。

画像エンコーダーによる特徴抽出

まず、入力された画像は「画像エンコーダー」によって処理されます。代表的な画像エンコーダーである「Vision Transformer (ViT)」は、画像を小さなパッチ(断片)に分割します。そして、それぞれのパッチが持つ色や形、テクスチャといった視覚的な特徴を捉え、数値の連続値である特徴ベクトルに変換します。このプロセスにより、コンピューターが直接は扱えないピクセルの集合体が、意味を持つ数値データの集合へと変わるのです。

アダプターモジュールによる空間の橋渡し

次に、画像エンコーダーから出力された特徴ベクトル群は、そのままではテキストを専門とするLLMが直接理解できません。そこで、Q-Formerのような「アダプターモジュール」が、画像の特徴ベクトル群から重要な情報を抽出し、LLMが扱う言語の埋め込み空間へとマッピング(変換)します。この「橋渡し」の工程が、視覚情報と言語情報を融合させるための鍵となります。

テキストと画像のトークン統合プロセス

最終段階では、アダプターによってLLMが解釈できる形式に変換された画像情報と、ユーザーが入力したプロンプトのテキスト情報が統合されます。LLMは、これら2種類の情報を一連のシーケンスとして受け取り、言語モデルとしての能力を最大限に活用して処理します。この統合プロセスにより、画像の内容とテキストの指示を関連付けた上で、最適な回答や説明文を生成できるのです。ただし、医療や自動運転といった高リスク分野へ適用する際は、変換過程の限界や誤認識リスクを理解し、必ず専門家による確認プロセスを設けることが極めて重要です。

https://media.a-x.inc/llm-architectureLLMの画像認識でできること【活用事例7選】

LLMの画像認識技術は、すでに様々なビジネスシーンで活用が始まっています。商品説明の自動生成といったマーケティング業務の効率化から、製造ラインにおける精密な品質管理、さらには医療分野での研究開発まで、その応用範囲は多岐にわたります。ここでは、具体的な7つの活用事例を紹介します。

1. 画像キャプション生成と説明

ECサイトやメディアサイトで大量の画像を扱う際に、LLMは絶大な効果を発揮します。商品画像や風景写真などをアップロードするだけで、その内容を的確に説明するキャプションや代替テキスト(alt属性)を自動で生成できます。これにより、コンテンツ制作の工数を大幅に削減できるだけでなく、SEO対策の強化にも繋がります。

2. VQA(Visual Question Answering)による質疑応答

VQAは、画像の内容についてユーザーが質問すると、AIが対話形式で回答する技術です。例えば、マニュアル内の図版について「この部品の名称は?」と質問したり、不動産サイトで物件の写真を見ながら「この部屋の日当たりは良いですか?」と尋ねたりできます。カスタマーサポートの自動化や、より直感的な情報検索システムの構築に応用できるでしょう。

3. OCRを超えた文書・図表の読み取り

従来のOCR(光学的文字認識)は、テキストを読み取ることはできても、そのレイアウトや構造までは理解できませんでした。LLMの画像認識は、請求書や契約書、アンケート用紙などの複雑なフォーマットを理解し、「請求金額」や「契約者名」といった特定の項目を的確に抽出できます。これにより、データ入力業務の自動化レベルを飛躍的に向上させます。(出典:Unifying Vision-and-Language Tasks via Text Generation)

4. 製造業における異常検知と品質管理

製造ラインを流れる製品の画像をリアルタイムで解析し、傷、汚れ、寸法のズレといった異常を瞬時に検知できます。従来のルールベースの画像検査システムよりも柔軟性が高く、未知の不良パターンにも対応しやすいのが特長です。これにより、品質管理の精度向上と検査コストの削減を両立させます。

5. 小売業での商品棚分析と在庫管理

店舗のカメラで撮影した商品棚の画像を分析し、商品の欠品、陳列の乱れ、価格表示の誤りなどを自動で検出します。店員はアラートを受けてから対応すればよいため、機会損失の防止と棚管理業務の効率化に大きく貢献します。また、顧客の動線や商品の手に取られ方を分析し、マーケティング戦略に活かすこともできます。ただし、顔や個人を識別できるデータを扱う際は、個人情報保護法や関連ガイドラインを遵守することが絶対条件です。利用目的の明示、本人の同意取得、または適切な匿名化処理といったプライバシー保護措置を講じる必要があります。(出典:カメラ画像利活用ガイドブック)

6. 医療画像の解析と研究支援

レントゲン写真やCTスキャンなどの医療画像をLLMが解析し、特定のパターンや異常の可能性がある箇所をハイライト表示することで、医師の研究や学習を支援します。ただし、これらの技術を医療機器として提供するには、各国の規制(日本の薬機法など)を遵守し、必要な承認を得る必要があります。AIによる解析はあくまで医師の判断を補助する参考情報であり、最終的な診断は必ず資格を持つ医師が行います。

7. 自動運転における高レベルな意思決定支援

自動運転において、LLMは高レベルな意思決定や説明生成で活用が期待されています。例えば、交通状況の複雑な文脈を理解し、「なぜルートを変更したのか」を乗員に自然言語で説明したり、事故後の状況を要約して報告書を作成したりする役割です。車両のリアルタイムな認識や制御は、センサーフュージョンと低レイテンシで動作する専用モデルが担います。実運用にあたっては、各国の法規制への対応や、車両メーカー等との共同による厳格な安全検証が不可欠です。

Route66様の事例

マーケティング支援を手掛けるRoute66様では、コンテンツ制作における原稿執筆が大きな時間的負担となっていました。AX CAMPの支援を通じたクライアントの報告によると、特定のテンプレート記事のドラフト作成にAIライティングツールを導入した結果、従来24時間かかっていた作業が10秒程度で完了するケースがあったとのことです。(出典:【AX事例】生成AIで月80時間の工数削減。伴走支援でAI人材を育成し、組織全体の生産性を向上へ。)

WISDOM合同会社様の事例

SNS広告やショート動画制作を行うWISDOM合同会社様は、事業拡大に伴う人材採用に課題を抱えていました。AX CAMPでAI活用スキルを習得し、定型的なレポート作成やデータ集計といった業務の自動化を推進。同社報告では、AI導入により当初想定していた2名分の作業負荷に相当する業務を自動化できたとのことです(ただし、生成物の最終確認や判断は人間が行います)。これにより、採用コストをかけずに生産性を向上させることに成功しました。(出典:【AX事例】生成AIで月80時間の工数削減。伴走支援でAI人材を育成し、組織全体の生産性を向上へ。)

C社様の事例

SNS運用代行を行うC社様では、投稿コンテンツの作成と分析に多くの時間を要していました。AXの支援を通じてAI活用を進めた結果、SNS運用にかかる時間が3時間から1時間へと66%削減されました。さらに、データ分析に基づいたコンテンツ改善により、月間1,000万インプレッションを達成したと報告されています。(出典:AI導入の成功事例15選!業務効率化やコスト削減を実現する活用法)

【2026年最新】注目のLLM画像認識モデル・サービス5選

LLMの画像認識技術は日進月歩で進化しており、各社から高性能なモデルが次々と発表されています。2025年現在、特に注目すべきは、GPT-5、Gemini 2.5 Pro、Claude Sonnet 4.5といった最先端のモデル群です。これらのモデルは、それぞれに異なる強みを持ち、画像認識の可能性をさらに広げています。

1. OpenAI GPT-5

2025年8月7日に公開されたGPT-5は、前モデルからさらにマルチモーダル性能が強化されています。静止画だけでなく動画の内容理解にも長けており、複雑なシーンの状況説明や、動画内の特定のイベントに関する質疑応答で高い精度を発揮します。論理的推論能力と画像理解の融合により、より高度な分析タスクに対応できるのが強みです。(出典:Introducing GPT-5)

2. Google Gemini 2.5 Pro

2025年6月17日に一般提供(GA)が開始されたGemini 2.5 Proは、設計当初からマルチモーダルであることを前提に構築された「ネイティブ・マルチモーダル」モデルです。テキスト、画像、音声、動画など、あらゆるデータをシームレスに扱える柔軟性が特長です。特に、Googleの膨大なデータと計算インフラを活かした高精度な画像認識と、リアルタイム性の高さで評価されています。(出典:Gemini 2.5 Pro Overview)

3. Anthropic Claude Sonnet 4.5

2025年9月29日に公開されたClaude Sonnet 4.5は、安全性と信頼性を重視するAnthropic社が開発したモデルで、ビジネス用途での活用に強みを持ちます。特に、図やグラフ、手書き文字などが含まれるビジネス文書の読み取り精度が非常に高く、ハルシネーション(誤った情報を生成する現象)を抑制する設計がなされています。企業コンプライアンスが重視される場面での活用が期待されます。(出典:Claude Sonnet 4.5)

4. Meta Llama 3.2

Metaが2024年9月にリリースしたLlama 3.2は、オープンソースモデルの最新版であり、その高い性能とカスタマイズの自由度から注目を集めています。企業は自社のサーバー上でこのモデルを自由に調整し、特定の業務に特化した画像認識システムを構築できます。コストを抑えつつ、独自のAIソリューションを開発したい場合に有力な選択肢となります。(出典:Meta、マルチモーダル対応の「Llama 3.2」をオープンソースで公開)

5. Apple Ferret-UI

Appleが発表したFerret-UIは、スマートフォンのUI(ユーザーインターフェース)操作に特化したユニークなモデルです。画面上のアイコンやボタン、テキストなどを正確に認識し、「このボタンをタップして」といった自然言語の指示で操作を自動化する能力を持ちます。アプリのテスト自動化やアクセシビリティ向上への貢献が期待されていますが、Ferret-UIは研究目的のプロジェクトであり、商用提供の状況は未確定です(2025年11月時点)。(出典:Ferret-UI: Grounded Mobile UI Understanding with Multimodal LLMs)

LLM画像認識のメリット

LLM画像認識をビジネスに導入することには、多くのメリットが存在します。中でも特に重要なのが、「高度な文脈理解による分析精度の向上」「プロンプトによる柔軟なタスク実行」「開発コストと期間の削減」という3つの利点です。これらは、業務効率化と新たな価値創造の双方に大きく貢献します。

高度な文脈理解による分析精度の向上

LLMは、画像に写っている個々のオブジェクトを認識するだけでなく、それらの関係性や配置、背景にある状況まで含めた「文脈」を理解します。例えば、工場の部品画像を分析する際に、単に「ネジ」と認識するだけでなく、「緩んでいるネジ」や「摩耗しているネジ」といった状態の変化や異常の兆候まで捉えることができます。これにより、分析の精度が格段に向上し、より的確な意思決定に繋がるのです。

プロンプトによる柔軟なタスク実行

従来の画像認識では、タスクごとに専門のAIモデルを開発・学習させる必要があり、多大なコストと時間がかかりました。LLMを活用すれば、自然言語によるプロンプト(指示文)を与えるだけで、様々なタスクを実行させることが可能です。「この画像の要点を3つ教えて」「画像内のテキストをすべて書き出して」といったように、目的に応じて指示を変えるだけで、一つのモデルが多様な役割を果たします。

開発コストと期間の削減

GPT-5やGemini 2.5 Proといった高性能なLLMは、API(Application Programming Interface)を通じて手軽に利用できます。これにより、企業はAIモデルをゼロから開発する必要がなくなり、APIの活用によって開発にかかるコストと期間を大幅に削減できます。既存のシステムやアプリケーションに画像認識機能を組み込む際のハードルが大きく下がり、中小企業やスタートアップでも最先端のAI技術を迅速に導入することが可能です。

LLM画像認識の課題と今後の展望

LLMの画像認識は非常に強力な技術ですが、万能というわけではありません。実用化にあたっては、「ハルシネーション(幻覚)」のリスクや「計算コストと環境負荷」といった課題が存在します。これらの課題を理解し、対策を講じることが、技術を安全かつ効果的に活用する上で不可欠です。

ハルシネーション(幻覚)のリスク

ハルシネーションとは、AIが事実に基づかない、もっともらしい嘘の情報を生成してしまう現象です。画像認識の文脈では、画像に存在しないものを「ある」と説明したり、写っている内容を誤って解釈したりする形で現れます。例えば、医療画像の解析で正常な部位を異常と指摘する、自動運転で障害物を見間違えるといった事態は、深刻な結果を招く可能性があります。そのため、特に正確性が求められる分野では、AIの出力を人間が必ず確認するなどの対策が重要です。例えばAX CAMPの伴走支援では、導入前に検証手順や品質の閾値、最終判断者(例:品質管理責任者)を明確にし、クライアント企業と合意書で責任の範囲を定めるなど、具体的な運用体制の構築をサポートします。

計算コストと環境負荷

最先端のLLMを動作させるには、高性能なGPU(Graphics Processing Unit)を多数搭載した大規模な計算インフラが必要です。このインフラの構築・維持には莫大なコストがかかり、APIの利用料金にも反映されます。また、大量の電力を消費するため、環境への負荷も無視できない課題となっています。今後は、より少ない計算資源で動作する軽量なモデルの開発や、エネルギー効率の高いハードウェアの進化が、技術の普及に向けた鍵となるでしょう。

LLM画像認識を試すための基本ステップ

LLMの画像認識を自社の業務で試してみたいと考えた場合、どこから手をつければよいのでしょうか。専門的な知識がなくても、APIを利用する方法が最も手軽で迅速です。ここでは、導入に向けた基本的なステップと、効果を引き出すためのポイントを解説します。

APIを利用した手軽な導入方法

現在、OpenAI(GPTシリーズ)、Google(Geminiシリーズ)、Anthropic(Claudeシリーズ)など、多くの企業が画像認識機能を持つLLMのAPIを提供しています。これらのAPIを利用すれば、数行のコードを記述するだけで、自社のアプリケーションや業務システムに最先端の画像認識機能を組み込むことが可能です。サーバーの構築やモデルの管理は不要で、利用した分だけ料金を支払う従量課金制が一般的です。まずは小規模なPoC(概念実証)から始めるのに最適な方法と言えます。

オープンソースモデルの環境構築

より高度なカスタマイズや、セキュリティ上の理由で外部APIを利用できない場合は、オープンソースのLLMを自社のサーバー環境に構築する方法もあります。Hugging Faceなどのプラットフォームでは、MetaのLlamaシリーズをはじめとする多様なモデルが公開されています。この方法は、モデルを自由にチューニングできるというメリットがある一方で、高性能なサーバーの準備や、モデルの専門知識を持つエンジニアが必要となるため、導入のハードルは高くなります。

効果的なプロンプトの設計ポイント

LLMの画像認識性能を最大限に引き出す鍵は、プロンプトの設計にあります。AIに何をさせたいのかを、具体的かつ明確に指示することが重要です。例えば、単に「この画像を説明して」と指示するよりも、「あなたはプロのマーケターです。この商品の画像を見て、顧客の購買意欲を高めるキャッチコピーを3つ提案してください」のように、役割、文脈、出力形式を細かく指定することで、期待する結果を得やすくなります。試行錯誤を繰り返しながら、タスクに最適なプロンプトを見つけることが成功への近道です。

LLMの画像認識活用ならAX CAMPへご相談ください

LLMの画像認識が持つ可能性を理解しても、「具体的に自社のどの業務に適用できるのか」「どのモデルやサービスを選べば良いのかわからない」といった悩みは尽きないかもしれません。また、導入後の効果的なプロンプト設計や、現場への定着には専門的なノウハウが必要です。

もし、あなたがLLMの画像認識技術を本格的にビジネスへ活用したいとお考えなら、ぜひ一度、私たちAX CAMPにご相談ください。AX CAMPは、単なる知識の提供にとどまらない、実務直結型の法人向けAI研修・伴走支援サービスです。貴社の具体的な業務課題をヒアリングし、最適なLLMの選定から、業務フローへの組み込み、効果を最大化するためのプロンプトエンジニアリングまで、専門家が一気通貫でサポートします。実際に、本記事でご紹介した企業様のように、AI導入によって劇的な業務効率化を実現した公式な実績もございます。

机上の空論で終わらない、現場で実際に成果を出すためのAI活用を、私たちと一緒に実現しませんか。まずは無料相談にて、貴社が抱える課題やAI活用の展望をお聞かせください。貴社の状況に合わせた最適な活用プランをご提案します。

まとめ:LLMの画像認識でビジネスの可能性を広げよう

本記事では、LLMによる画像認識の仕組みから、従来のAIとの違い、具体的な活用事例、そして最新のモデル動向までを解説しました。技術はまだ発展途上であり、ハルシネーションなどの課題も残されていますが、そのポテンシャルは計り知れません。

この記事の要点をまとめます。

- LLM画像認識は、画像とテキストを同時に理解し、文脈に基づいた対話や分析ができる技術です。

- 従来の特化型AIと異なり、プロンプト一つで多様なタスクをこなせる柔軟性が最大の強みです。

- 活用範囲は、コンテンツ制作の自動化から製造業の品質管理、医療分野の研究支援まで多岐にわたります。

- 導入はAPIを利用するのが最も手軽で、開発コストを抑えながら迅速に試すことができます。

この革新的な技術を自社の競争力に変えるためには、技術を正しく理解し、具体的な業務課題と結びつけて考える視点が不可欠です。もし、社内でのAI活用推進に行き詰まりを感じていたり、専門的な知見を持つパートナーを探していたりするのであれば、AX CAMPがお力になります。実践的な研修と伴走支援を通じて、貴社のAI導入を成功へと導きます。